Такие устройства, как Amazon Alexa и Google Home, ускорили внедрение в массовые товары технологии голосового управления, но они все еще ограничены простыми командами. Создание достаточно умных для ведения реальной беседы машин остается очень сложной задачей. И этого трудно добиться без базового понимания действий в реальном мире.

Попытки решить эту проблему путем прямого кодирования соответствия между словами, объектами и действиями требует бесконечного множества правил, что делает машину не способной к адаптации в новой ситуации. А устройства, изучающие язык самостоятельно, обычно требуют значительной помощи со стороны человека.

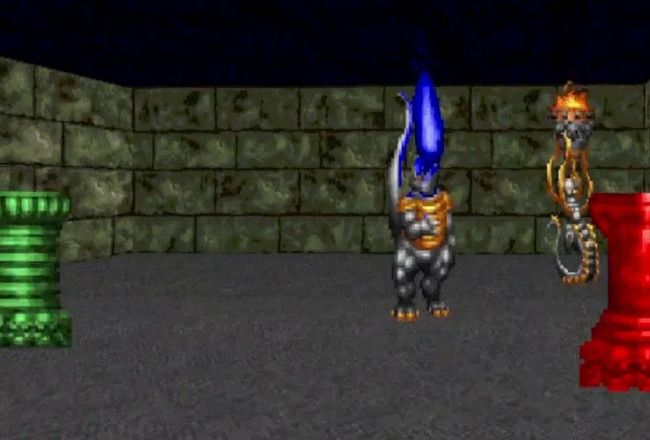

Сейчас группа специалистов из DeepMind, дочерней компании Alphabet, а также Университета Карнеги-Меллон (CMU) разработала механизм, позволяющий машинам определять простые принципы языка в трехмерных средах на основе компьютерных шутеров от первого лица.

«Возможность сделать это в 3D является значительным шагом к тому, чтобы суметь воспроизвести и в реальном мире», - говорит Девендра Чаплот, студент магистратуры в CMU, который представит свой доклад на ежегодном собрании Ассоциации компьютерной лингвистики. Конечная цель, по его словам, заключается в создании симуляции, столь близкой к реальной жизни, что ИИ сможет передавать полученную информацию в реальный мир.

Подходы DeepMind и CMU используют глубокое обучение с подкреплением, популяризированное игровым ИИ DeepMind Atari. Обычной целью может быть достижение высокой оценки в игре. Например, двум программам ИИ была дана команда «подойти к зеленой колонне». После перехода к объекту полагалось вознаграждение.

Проигрывая миллионы сценариев обучения на ускоренных скоростях, обе программы ИИ научились ассоциировать слова с конкретными объектами и характеристиками, которые позволяют им следовать командам. Они даже стали понимать реляционные термины, такие как «больше» или «меньше», чтобы различать похожие объекты.

Самое главное, обе программы могут обобщить то, что они узнали лишь в виртуальности. Если в сценариях обучения были колонны, а также красные предметы, они могли бы выполнить команду «перейти к красной колонне», даже если они никогда не видели ее на тренировках.

«Это делает их гораздо более гибкими, чем предыдущие системы на основе правил», - говорит Чаплот. Команда CMU сочетает визуальный и вербальный подход таким образом, чтобы сосредоточить внимание ИИ на наиболее релевантной информации, в то время как DeepMind добавил дополнительные цели обучения. Поскольку два метода решают проблему несколько по-иному, Чаплот надеется, что их объединение может предоставить машинам расширенные возможности.

Комментарии

(0) Добавить комментарий